AI时代,产品经理需要掌握的5项新技能

2020年1月25日, 在曼彻斯特产品思维大会上,Salesforce 爱因斯坦系统的产品总监马尤克·博瓦尔做了个分享,探讨了在人工智能时代,产品经理需要做哪些调整,以及如何打造成功的人工智能产品。演讲主题《人工智能如何改变产品管理的职业描述 How AI Is Changing The Product Management Job Description by Mayukh Bhaowal》

一、故事

在步入正题之前,我们从一些有趣的故事开始:

1. AI正在瓦解传统的职业定义

在几个月前的马萨诸塞州剑桥城,聚集了在成百上千的技术爱好者,一名来自斯坦福的教授在白板上写着东西。他在探讨人工智能是如何改变世界,探讨传统的职业是如何被AI打破和瓦解的。这位教授就是吴恩达,一家名为“Landing AI”的公司的创始人,他也是著名的在线教育公司Coursera的创始人。在他的分享中提到了一段产品经理的工作的描写。

同时,产品经理还需要更新技能树的五个方面:1. 问题映射,2. 数据素养,3. 验收标准,4.可解释性、伦理和偏移,5.将研究迁移到生产。

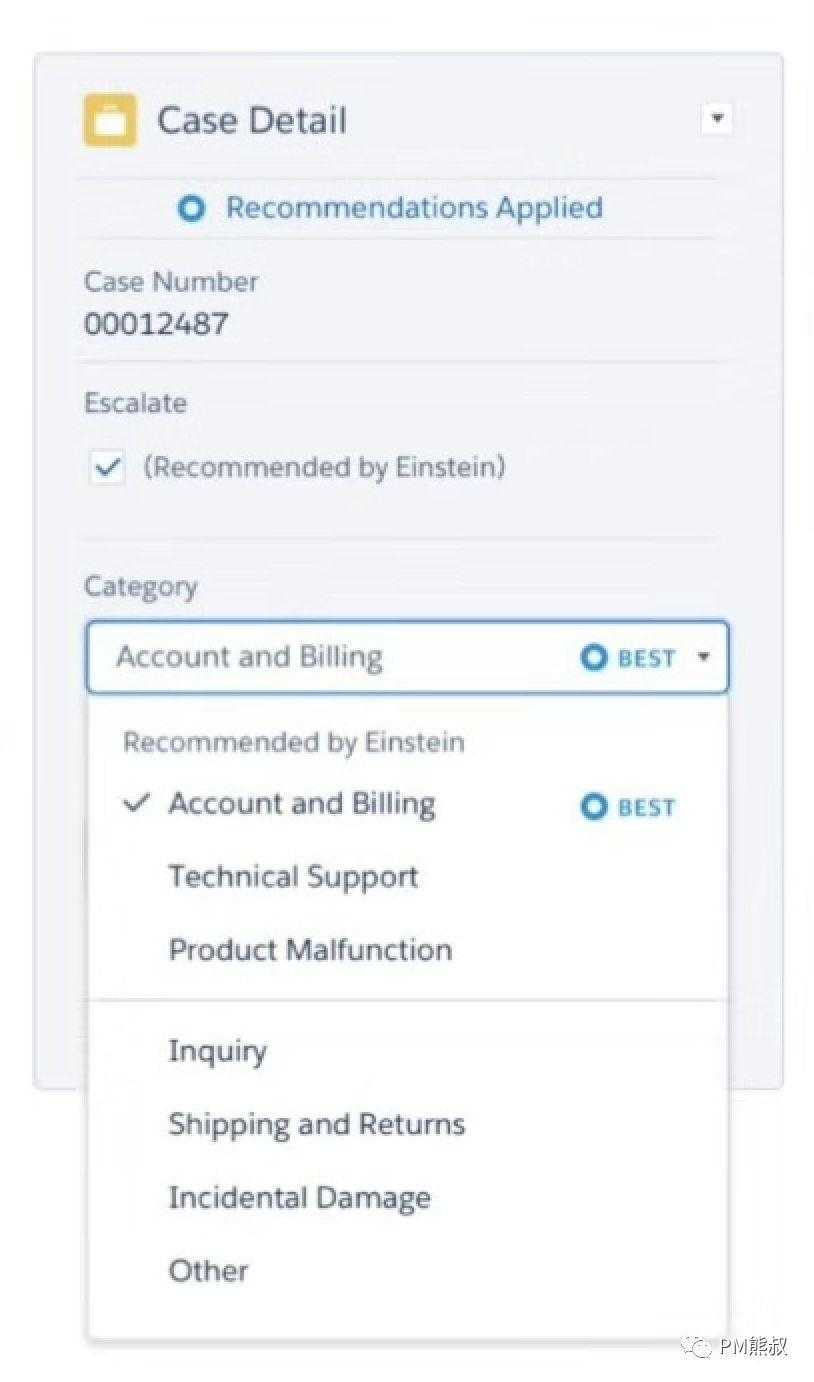

因为这些字段有助于正确地将客服案例指向到正确的部门。从而让它们可以得到快速解决。如果缺乏这些字段,客服案例很可能会被错误的分配到其他部门。导致它们在不同的部门之间来回流转,从而浪费了宝贵的解决时间。

可能,每个产品经理会这么想:通过使用一些规则,根据客服案例中的其他字段来填写此字段中的值。但通过进一步分析,我们会发现这样的规则是很繁琐的。它不会随着时间的推移而扩展,它将变得难以管理。坦率地说,有时候一个严格的规则并不能真正抓住价值。

但倘若你有一段自由格式的文本并缺少关键字段和描述,您无法找出将其映射到“产品”和“类别”的规则。此时,你就可以使用人工智能了。实际上,这可以建模为一个多分类问题。这些字段中的每个值都对应多个分类。您可以通过肉眼从历史的客服案例中学习和获得相应的感知,例如通过查看标题和描述来确定预测值应该是什么。

在我们的“爱因斯坦”系统中,我们可以看到这些字段的预测值。每个预测值都有相应的置信等级。人们可以通过肉眼使用传统的方法进行评估,而不是冒着风险使用AI去解决问题。请记住,我们每时每刻都应该将解决方案映射回业务问题上——即缩短客服案例的解决时间。

2. 数据是新的用户界面 (Data is the New UI)

在AI时代,产品经理的职责是什么呢?我认为,产品经理最重要的职责之一就是提供数据规范。众所周知,数据是任何机器学习算法的基础。

我们首先要问的是:我们有足够的数据吗?如果没有,那么也就没有训练机器学习模型的数据集,也就无法从数据集中的预测信号中进行学习。

第二个要问的是:在现实世界中,你的数据有多干净或有多少噪声?但据我们所见,你的大部分数据都是非常混乱和充满噪声的。它可能存在于第三方系统中。当你开始给机器学习之前,你可能还需要连不同来源的数据,再导入到数据仓库之中。

第三个要问的是:历史数据中是否存有用来给机器做监督训练的样例?也就是所谓的监督分类问题。如果没有样例来训练机器学习模型,数据科学家还得想其他的办法。

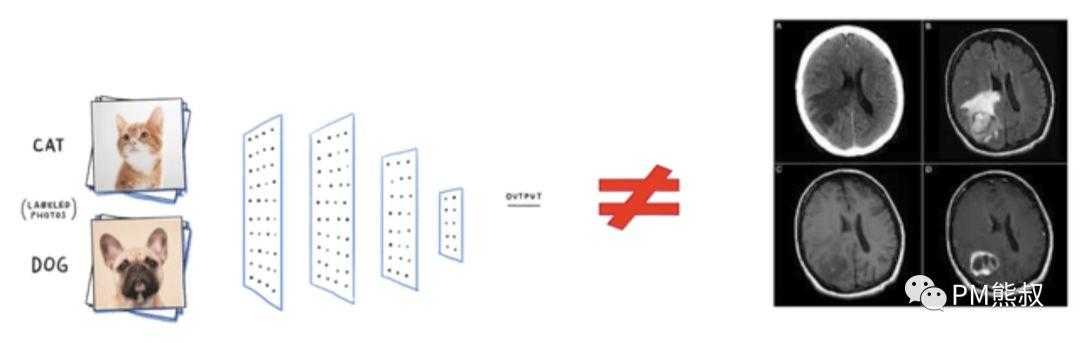

以一种通用的图像识别的AI产品为例:

这是一个理想分类器的例子,它能将每一笔欺诈性交易都归为欺诈,良性的交易依然还是良性。数据科学家会做出反应 并说这是完美的精确和完美召回率,但这只是一个永远无法实现的梦想分类器。

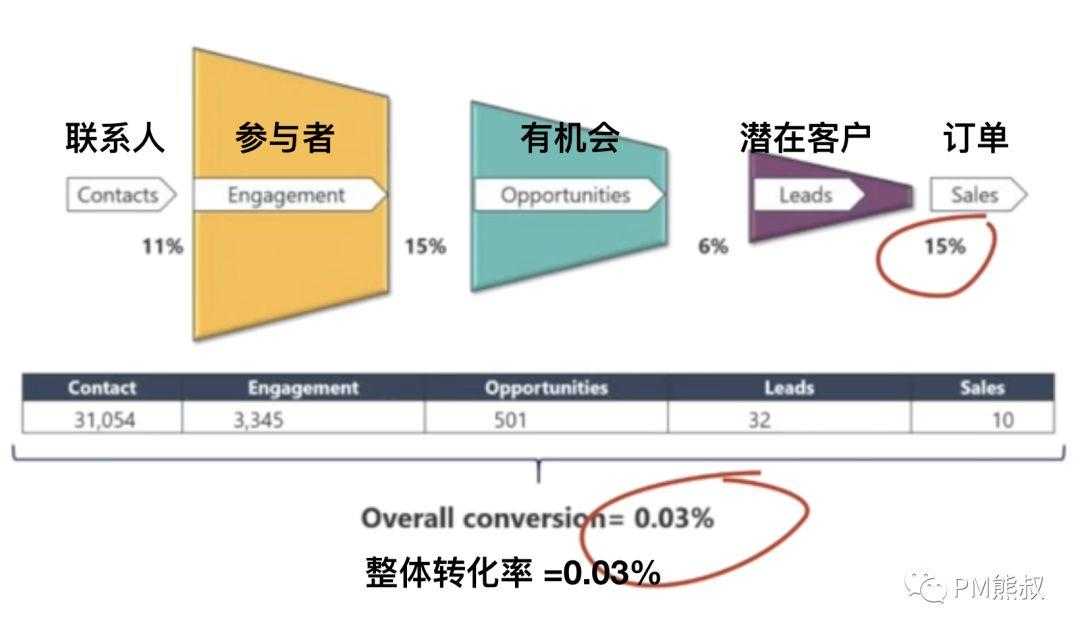

我们正试图预测潜在客户销售成功的可能性。例如,格雷格·汤姆森先生得分是88。这意味着他有88%的可能性转化为销售订单。但比较棘手地方在于它是一个转化率,我们还需要考虑整体的转化漏斗。

这里有两个重要的指标:一个是由产品经理根据业务需求所决定的业务指标;另一个是针对当前的案例,与数据科学家和数据工程师合作得出的数据科学指标。而后者能帮助你在商业中树立竞争壁垒。

因此,当你准备向实际用户推出AI产品时候,你可以先明确这些额外的验收标准。

4. 可解释性、伦理和偏见(Explainability, Ethics & Bias)

如今,我们的许多客户正在体验我们的这套预测应用。其中最常的问题是:“为什么机器学习模型没有做出它所做的决定呢?”

事实上,人工智能软件根本不同于传统软件。因为它的结果并不是基于一组写好的代码产生的。随着时间的推移,随着数据和反馈循环加深,该软件的会越来越像一个黑盒。但我们还需要考虑可解释性,因为这将有助于建立用户对产品的信任。

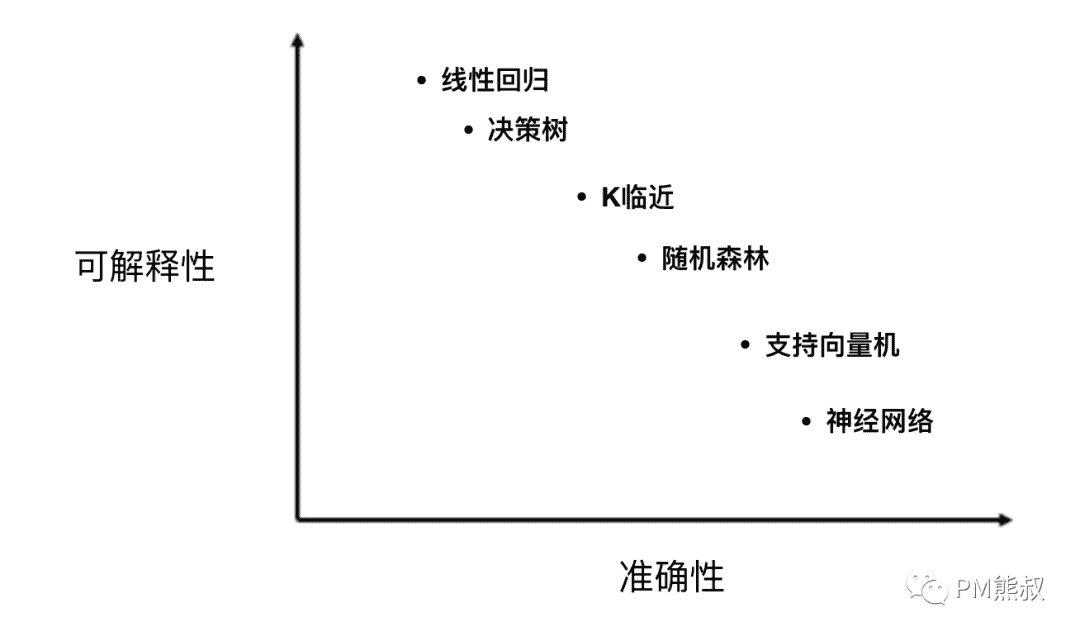

这里有一张图,能够帮助我们评估可解释性和精确性:

从图中可以看出,我们需要为机器学习的可解释性和精确性做极大地权衡。相对简单的模型,如线性回归或决策树,准确性较差但可解释性较好;而神经网络、深度学习的准确性极高,但却更像个黑盒。产品经理需要根据特定的应用场景和用例来做出决策。

如果你的产品面向于一个高度监管的行业,法律要求这些预测是可解释的。比如,医疗健康和法律领域需要符合欧盟的《通用数据保护条例》。可解释性和精确率之间应该如何平衡?

作为产品经理需要相应的保持洞察力,并在第一时间与数据科学家和数据工程师保持同步。

另外,产品经理也需要想想这个产品是否有性别和伦理方面的影响:如数据需要具有足够的多样性、典型性,或者不能产生如种族歧视和性别的偏见问题。

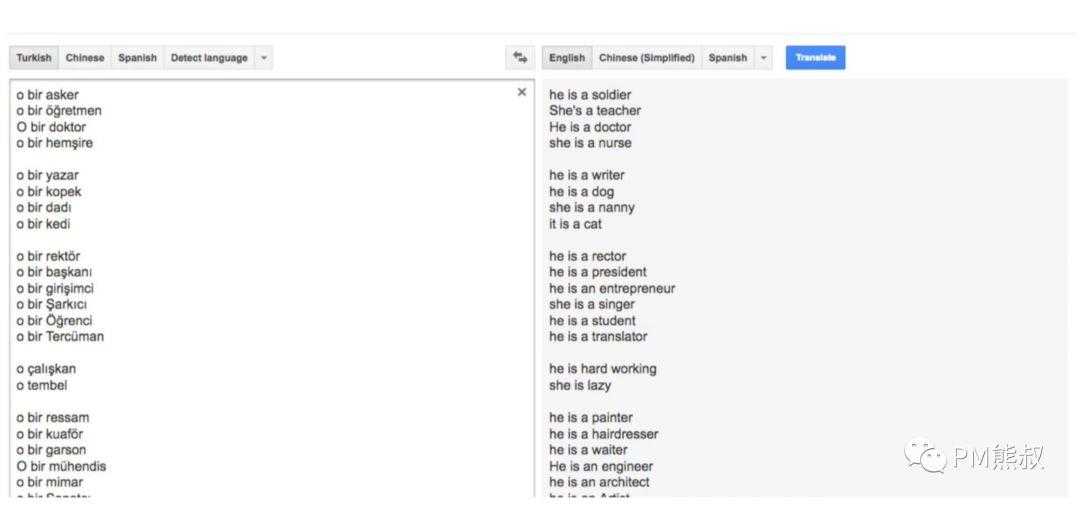

我最喜欢举的一个例子这是谷歌翻译,左边是无性别区分的土耳其语,右边是对应的英文翻译。如果你顺着往下念很快就能发现这个偏见:他(男性)很努力地工作,她(女性)很懒。可见灾难性的性别偏见已经渗透到这个产品中。

或许你会想到一个功能来去剔除掉性别。但事情没有那么简单,性别是医学诊断的一个极其重要的特征和信号。例如,前列腺癌只发生在男性身上。

可能在翻译产品中关系不大,但在人力资源招聘系统中匹配求职者的职位描述关系非常大。我们似乎应该要提供一些关于如何处理偏见引导。

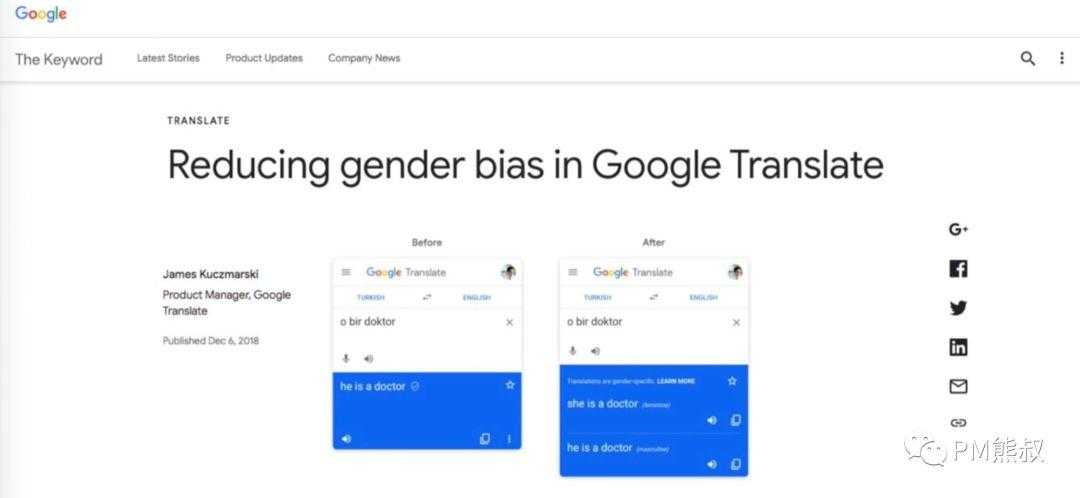

去年12月,谷歌发布了一个版本,解决了翻译中存在偏见,每一个中性的短语,它都会给出男性化和女性化的翻译。

5. 将研究投入生产(Scaling from Research to Production)

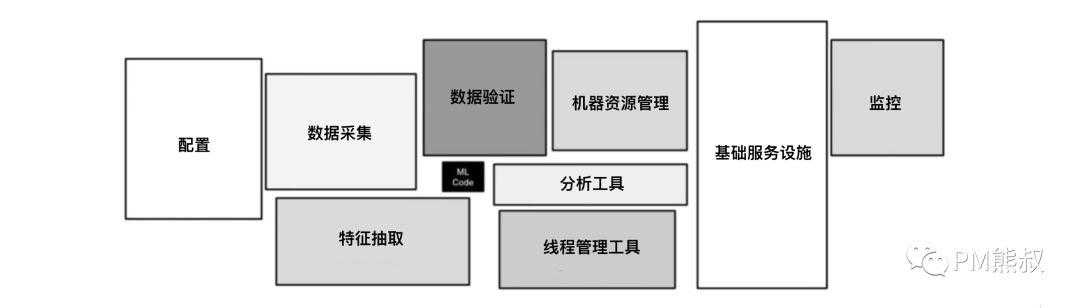

最具有挑战性的问题是,机器学习项目所需要的成功要素,研究环境和实际投产环境完全不同。下图源自一本非常有名的出版物,叫做《机器学习的隐性债务》:

真实世界的机器学习系统只有一小段机器学习代码,如中间的小黑盒所示。但其所需的周边基础设施庞大而复杂。这与大家普遍认知相反,您可能会认为机器学习是你的人工智能产品的最大和最主要组件,但在现实世界中它只是一小块。

在我们的Salesforce的爱因斯坦系统,也有一张非常相似的图。

数据科学家和数据工程师实际上正在设计这样的一款产品,它需要能够回答各式各样的问题才能真正被带到生产环境中去。

“是否确认你的数据是本地还是在云端?”

“是否确认你的机器学习模型是在服务器上,或者不需要分发到移动设备?”

“你是否准备重新训练你的机器学习模型,因为什么动机呢?”

“你是否确认产品需要实时预测?因为实时预测是非常有用的,但这又是非常复杂和难以设计的,又或许您可以使用一个离线批处理系统”……

每一天都会有成千上万的研究成果发表,但却少有应用到实际的规模生产。所以作为AI产品经理,我们必须建立起敏锐的洞察力:判断哪些产品值得投入,判断哪一种产品能够为实际的用户真正地生产。

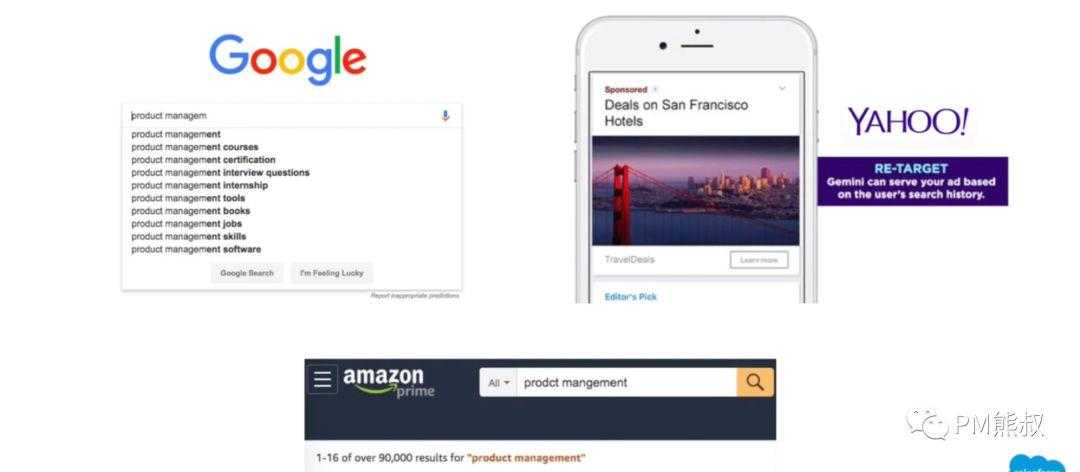

虽然最近AI很火,但它在20年前就已经存在了。过去主要应用在搜索和广告领域,你在谷歌时看到的搜索建议、你在雅虎上看到的推荐广告、你在亚马逊上搜索时的自动更正……如果你在搜索和广告领域工作那必须提供明确说明,并且与数据工程师紧密的合作。

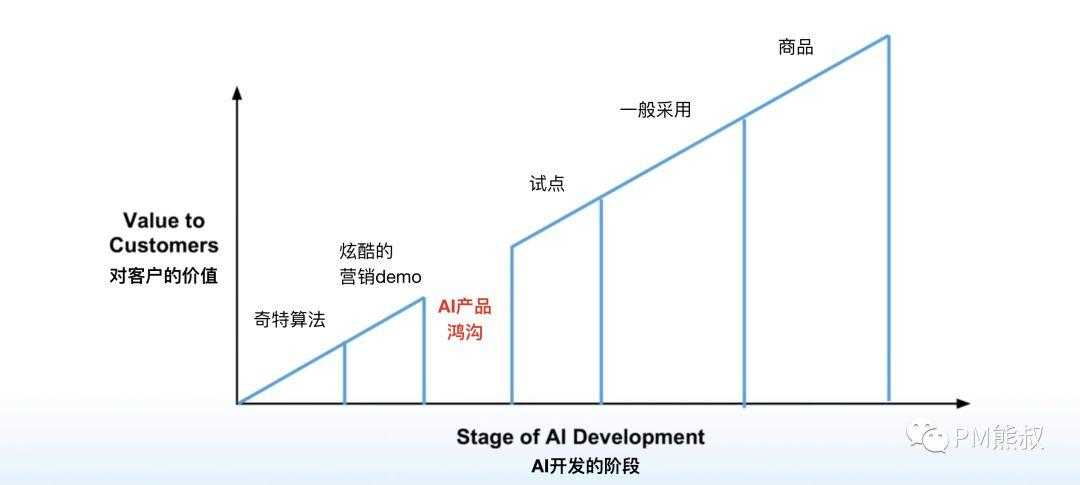

如今人工智能的应用领域呈指数级增长, 同时也需要产品经理提供大量明确的产品规范说明。不管你的数据科学家们是多么的喜欢你们的小花园,或者你的营销演示多么有创意和多么酷。“AI产品鸿沟”很可能会成为你的AI产品普及的障碍。

作为一个孤岛,越来越多的AI产品需要管理。作为一名产品经理你需要提升技能树。在你的工程项目中,能够实际地为数据科学家提供有价值的规范说明。

最后,请你回答一个问题:

当你面对一个真实的具体的客户痛点,你是否有能力打造一款有用的产品,而不是仅仅地做一个很酷的功能?

#相关阅读#

《AI时代下的产品思维(一):AI不是神》

#作者#

PM熊叔,微信公众号:PM熊叔。教育类产品产品经理出身,学过设计,做过开发,做过运营的产品经理。

本文

版权声明

本文来自互联网用户投稿,文章观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如若转载,请注明出处。如若内容有涉嫌抄袭侵权/违法违规/事实不符,请点击 举报 进行投诉反馈!