AIGC与AI技术谱系:从生成内容到大语言模型的全面解读

说起过去一年的热门科技词汇,AIGC当之无愧位列其中。

但你真的了解AIGC吗?

从某一天开始,我们突然发现AI可以生成文字、图片、音频、视频等等内容了,而且让人难以分清背后的创作者到底是人类还是AI。

这些AI生成的内容被叫做AIGC,它是“AI Generated Content”,即AI生成内容的简写。像ChatGPT生成的文章,GitHub Copilot生成的代码、Midjourney生成的图片等等,都属于AIGC。

一、生成式AI与相关领域的联系

而当AIGC这个词在国内火爆的同时,海外更流行的是另外一个词Generative AI,即生成式AI。从字面上来看,生成式AI和AIGC之间的关系很好理解,生成式AI所生成的内容就是AIGC。所以像ChatGPT、GitHub Copilot、Midjourney等都属于生成式AI。

由此可见,AIGC和生成式AI的概念都是很简单直白的。

但是因为AIGC这个词在国内比生成式AI更加流行,很多语境下AIGC也被用于指代生成式AI。

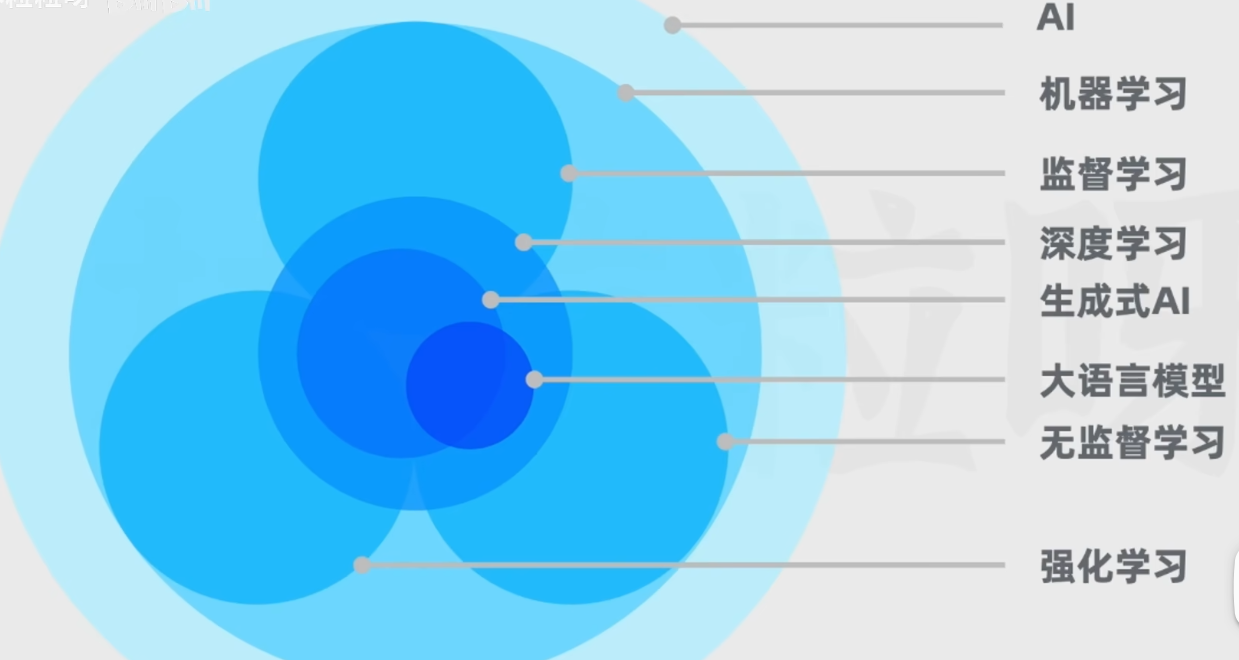

那么生成式AI和AI、机器学习、监督学习、无监督学习、强化学习、深度学习、大语言模型等等词汇之间又是什么关系呢?有没有一种剪不断理还乱的感觉?这个很难一言以蔽之,那通过一张图就可以直观理解它们之间的关系了。

AI也叫人工智能,是计算机科学下的一个学科,旨在让计算机系统去模拟人类的智能,从而解决问题和完成任务。

早在1956年,AI就被确立为了一个学科领域,在此后数十年间经历过多轮低谷与繁荣。

二、机器学习

机器学习是AI的一个子集,它的核心在于不需要人类做显式编程,而是让计算机通过算法自行学习和改进,去识别模式、做出预测和决策。

比如,如果我们通过代码告诉电脑,图片里有红色是玫瑰,图片里有说明是向日葵,那么程序对花种类的判断就是通过人类直接编写逻辑达成的,不属于机器学习,机器什么也没学。

但是如果我们给电脑大量玫瑰和向日葵的图片,让电脑自行识别模式、总结规律,从而能对没见过的图片进行预测和判断,这种就是机器学习。

机器学习领域下有多个分支,包括监督学习、无监督学习、强化学习。

在监督学习里,机器学习算法会接受有标签的训练数据,标签就是期望的输出值。所以每一个训练数据点都既包括输入特征,也包括期望的输出值。

算法的目标是学习输入和输出之间的映射关系,从而在给定新的输入特征后,能够准确预测出相应的输出值。

监督学习:

经典的监督学习任务包括分类,也就是把数据划分为不同的类别以及回归,也就是对数值进行预测。

比如拿一堆猫猫狗狗的照片和照片对应的“猫”“狗”标签进行训练,然后让模型根据没见过的照片预测是猫还是狗,这就属于分类。

拿一些房子特征的数据,比如面积、卧室数量、是否带阳台等和相应的房价作为标签进行训练,然后让模型根据没见过的房子的特征预测房价——这就属于回归。

无监督学习:

无监督学习和监督学习不同的是:他学习的数据是没有标签的,所以算法的任务是自主发现数据里的模式或规律。

经典的无监督学习任务包括聚类,也就是把数据进行分组。

比如拿一堆新闻文章,让模型根据主题或内容的特征自动把相似文章进行组织。

强化学习:

强化学习则是让模型在环境里采取行动,获得结果反馈。

从反馈里学习,从而能在给一定情况下采取最佳行动来最大化奖励或是最小化损失。所以就跟是小狗似的,刚开始的时候,小狗会随心所欲做出很多动作,但随着和驯犬师的互动,小狗会发现某些动作能够获得零食,某些动作没有零食,某些动作甚至会遭受惩罚。

通过观察动作和奖惩之间的联系,小狗的行为会逐渐接近训犬师的期望。

强化学习可以应用。

在很多任务上,比如说让模型下围棋,获得不同行动导致的奖励或损失反馈,从而在一局局游戏里优化策略,学习如何采取行动达到高分。

三、深度学习的方法与应用

那问题来了:深度学习属于这三类里的哪一类呢?

——他们属于里面的任何一类!

深度学习是机器学习的一个方法,核心在于使用人工神经网络模仿人脑处理信息的方式,通过层次化的方法提取和表示数据的特征。

神经网络是由许多基本的计算和储存单元组成,这些单元被称为神经元。

这些神经元通过层层连接来处理数据,并且深度学习模型通常有很多层,因此成为深度。

比如要让计算机时给小猫的照片。在深度学习中,数据首先被传递到一个输入层,就像人类的眼睛看到图片一样,然后数据通过多个隐藏层。

每一层都会对数据进行一些复杂的数学运算来帮助计算机理解图片中的特征,例如小猫的耳朵、眼睛等等。最后计算机会输出一个答案,表明这是否是一张小猫的图片。

神经网络可以用于监督学习、无监督学习、强化学习,所以深度学习不属于他们的子集。

生成式AI是深度学习的一种应用,它利用神经网络来识别现有内容的模式和结构,学习生成新的内容,内容形式可以是文本、图片、音频等等。

四、大语言模型 (LLM)

而大语言模型“Large Language Models”简称 LLM,也是深度学习的一种应用,专门用于进行自然语言处理任务。

大语言模型里面的大字说明模型的参数量非常大,可能有数十亿甚至到万亿个,而且训练过程中也需要海量文本数据集,所以能更好的理解自然语言以及生成高质量的文本。

大语言模型的例子有非常多,比如国外的GPT、LLaMA,国内的ERNIE、ChatGLM等,可以进行文本的理解和生成。

以GPT-3这个模型为例,它会根据输入提示以及前面生成过的词,通过概率计算逐步生成下一个词或token来输出文本序列。想对大语言模型背后的原理有更多了解的话,可以收看下一节视频。

但不是所有的生成式AI都是大语言模型,而所有的大语言模型是否都是生成式AI,这也存在些许争议。

前半句很好理解,生成图像的扩散模型就不是大语言模型,它并不输出文本。同时有些人认为不是所有大语言模型都是生成式AI,因为有些大语言模型由于其架构特点不适合进行文本生成。

谷歌的BERT模型就是一个例子,它的参数量和序列数据很大,属于大语言模型。

应用方面,BERT理解上下文的能力很强,因此被谷歌用在搜索上,用来提高搜索排名和信息摘录的准确性。它也被用于情感分析、文本分类等任务。但同时BERT不擅长文本生成,特别是连贯的长文本生成。所以有些人认为此类模型不属于生成式AI的范畴。

以上这些概念共同构成了AIGC的核心要素,希望能帮助你对时下热门的AIGC建立更多了解。

版权声明

本文来自互联网用户投稿,文章观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如若转载,请注明出处。如若内容有涉嫌抄袭侵权/违法违规/事实不符,请点击 举报 进行投诉反馈!